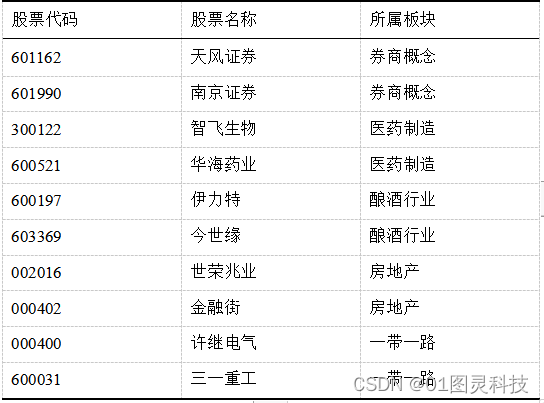

《动手学深度学习》---线性回归的从零开始实现的一些理解

李沐《动手学深度学习》---线性回归的从零开始实现的理解和笔记

目录

前言

沐神原版代码如下:

linear-regression-scratch slides https://courses.d2l.ai/zh-v2/assets/notebooks/chapter_linear-networks/linear-regression-scratch.slides.html#/之前都是直接调包,这里跟沐神动手自己实现了一下,还蛮有趣的。关于视频中的内容,我花了一些时间理解,在一些关键的代码步骤给出说明,希望能和大家一起讨论。

https://courses.d2l.ai/zh-v2/assets/notebooks/chapter_linear-networks/linear-regression-scratch.slides.html#/之前都是直接调包,这里跟沐神动手自己实现了一下,还蛮有趣的。关于视频中的内容,我花了一些时间理解,在一些关键的代码步骤给出说明,希望能和大家一起讨论。

步骤

一、人工生成噪声数据

import torch

import random

from d2l import torch as d2l

def generate_data(w, b, num):

X = torch.normal(0, 1, size=(num, len(w)))

y = torch.matmul(X, w)+b

#加入噪点项

y += torch.normal(0,0.01, y.shape)

return X,y

w=torch.tensor([2,-3.4])

b=4.2

X,y = generate_data(w,b,1000)

print(X.shape)

print(y.shape)d2l是李沐将视频教程中要用的常用功能集成的一个包 。

normal生成正态分布的X,matmul为矩阵的乘积。

这里y加入噪点的作用是为了使数据更加“逼真”,因为现实生活中的数据必然会有更多的噪声,数据分布更加不规则。

通过这个函数生成了1000个X和y,其中X形状为(1000,2),y的形状为(1000)。

展示一下数据

d2l.set_figsize()

d2l.plt.scatter(X[:,1].detach().numpy(),y.detach().numpy(),1)

二、写一个函数获取批量数据

通过步骤一得到了1000个X和y,但是使用所有的X和y进行梯度更新太耗时了,所以我们常常使用批量随机梯度下降(sgd)更新参数w和b。比如设置批量=10,也就意味着每次使用1000个X和y中的10个X和y来进行参数的更新。为此,我们要写一个函数来从1000个数据集中每次返回固定批量的数据。

#定义一个data_iter 函数, 该函数接收批量大小、特征矩阵和标签向量作为输入,生成大小为batch_size的小批量

def data_iter(batch_size,features,y):

num_features = len(features)

indices = list(range(num_features))

random.shuffle(indices)

for i in range(0,num_features,batch_size):

batch_indices = torch.tensor(indices[i:min(i+batch_size,num_features)])

yield features[batch_indices],y[batch_indices]函数输入参数有三个:

batch_size表示我要从该函数获取的批量数据的大小。

features表示所有的特征数据集,在这里也即是1000个从步骤一中获取的X。

y表示所有label的数据集,在这里也即是1000个从步骤一种获取的y。

好,咱们进入函数内部看看有什么可以说的!

num_features存一下features的个数(=1000)。

indices是一个列表,存储的是0~num_features(即0~999)。

接下来我们把indices打乱,这样就可以实现随机梯度下降中的随机功能。

indices他其实是用来标识我们打算将哪些batch_size的数据通过该函数给返回。

下面的for循环可能不太好理解,着重讲解一下。

首先是这句

batch_indices = torch.tensor(indices[i:min(i+batch_size,num_features)])其中 indices[i:min(i+batch_size,num_features)] 的意思是

(1)如果i+batch_size > num_features,即总共1000个数据,如果i+batch_size >1000,那我们只能把取到i~num_features=1000。如果num_features/batch_size不是整数的话,那最后一个批量就取不完了。

(2)如果i+batch_size <=num_features,即总共1000个数据,如果i+batch_size <=1000,那么我们可以把当前这个批量取完。

当执行完该句后,会生成包含一个batch_size大小的indices(索引),且indices列表中的值是乱序的。然后将这个indices列表转成张量,用batch_indices表示。

接下来是

yield features[batch_indices],y[batch_indices]yield是类似于return的关键字,但是与return不同的是,我yield的时候不仅会return,还会记住当前的位置,下次在进入该函数时,会从上次yield的位置继续执行。基于这种特性,它可以当做一个迭代器使用。

简单举个例子:输出0~2

def test():

for i in range(3):

yield i

for j in test():

print(j)先把yield看成return,然后再加上记住当前位置的功能。

那么,for i in test():print(i) 先开始执行。

j=0时,调用test(),然后进入for循环得 i=0 ,yield i (即 return i并记录当前位置)。print(j)打印出0。

j=1时,调用test(),然后进入for循环得 i=1 ,yield i (即 return i并记录当前位置)。print(j)打印出1。

j=2时,调用test(),然后进入for循环得 i=2 ,yield i (即 return i并记录当前位置)。print(j)打印出2。

输出结果

所以回到上面的代码 yield features[batch_indices],y[batch_indices],也就是返回了一个迭代器,可以让我们每迭代一次,随机获得一个大小为batch_size的特征和label。

打印一下看看通过这个函数获得的batch_size=10批量数据

for X_batch,y_batch in data_iter(10,X,y):

print(X_batch,'\n',y_batch)

成功了!

三、定义训练需要的函数

定义线性函数

def linear(X,w,b):

return torch.matmul(X,w)+b定义均方误差损失函数

def squared_error(y_hat,y):

return (y_hat-y.reshape(y_hat.shape))**2/2因为我们生成的y是一维的,而我们实际上要的是用二维表示的列向量,所以要将y reshape成y_hat同样的形状。

随机初始化参数

w = torch.normal(0,0.01,size=(2,1),requires_grad=True)

b = torch.zeros(1,requires_grad=True)定义随机梯度更新函数

#参数更新不除以batch_size

def sgd(params,lr):

#被wrap的部分在backward过程中不会参与梯度计算

with torch.no_grad():

for param in params:

#参数以梯度的方向即负的方向导数最大方向更新

param -= param.grad*lr

#pytorch的梯度会累加,所以每次反向传播完应该将每个向量的梯度清零

param.grad.zero_()其中被 with torch.no_grad(): 包裹的语句,在反向传播中不参与梯度的计算。关于这一点,涉及计算图、正向传播和反向传播的原理,虽然沐神讲了,但是我个人感觉理解不够深,推荐一篇博客,看完感觉通透很多:PyTorch:梯度计算之反向传播函数backward()_精致的螺旋线的博客-CSDN博客介绍Pytorch中的DCG机制、backward()函数,并说明backward()函数的参数 https://blog.csdn.net/baidu_38797690/article/details/122180655

https://blog.csdn.net/baidu_38797690/article/details/122180655

对每个参数使用梯度下降更新的时候,是沿负梯度方向,关于梯度、等高线、和方向导数的概念,也强烈建议搜索资料了解清楚,毕竟沐神精力有限,这里没有讲太细。推荐一个视频:

梯度下降和等高线的故事_哔哩哔哩_bilibili用最通俗的语言讲什么是梯度,以及梯度下降。 https://www.bilibili.com/video/BV18r4y1e77a?spm_id_from=333.337.search-card.all.click由于pytorch的计算图中每个节点的梯度会累加,所以我们在每次参数更新后需要把所求参数的梯度清0。

https://www.bilibili.com/video/BV18r4y1e77a?spm_id_from=333.337.search-card.all.click由于pytorch的计算图中每个节点的梯度会累加,所以我们在每次参数更新后需要把所求参数的梯度清0。

我看弹幕有人问为什么这里明明没有用backward,但为什么能使用梯度(-param.grad*lr)去更新参数?

答:如果你看了我上面给你推的博客 ---- “PyTorch:梯度计算之反向传播函数backward()”,姑且把该博文称为博文nb,并且看了后面开始训练的代码你就懂了。

如图,这是李沐老师训练过程的代码,我们只关注红框内的三行代码,第一行是计算loss,根据博文nb,计算loss的过程就是正向传播的过程,这个过程会动态生成计算图。第二行就是反向传播backward了,这个过程实际上就已经把计算图中各节点的梯度计算出来了,然后再进入第三步调用sgd函数。所以进入sgd函数的时候,梯度就已经得到了,所以我们在sgd函数中没有进行反向传播也能使用梯度。

还有一个点值得注意,李沐老师在梯度更新的时候将公式写成了

param -= lr * param.grad / batch_size

当时一头雾水,弹幕也很懵逼,研究了一下,我觉得可以理解成我每次以该批量数据的平均梯度(param.grad / batch_size)去更新param。但事实上,你不除以batch_size影响也不大,而我这里给的代码就是不除以batch_size的。

经过测试,两种写法的实际差距如下:

可以看到,几乎没有差别。

四、训练过程

lr = 0.03

batch_size = 10

net = linear

num_epoches = 3

loss = squared_error

for epoch in range(num_epoches):

for feature,label in data_iter(batch_size,X,y):

#每一个批量更新一次参数

#先正向传播得到完整计算图

l = loss(net(feature,w,b),label)#其中linear(feature,w,b)得到一维列向量,label也是一维列向量。二者通过loss得到一维列向量,这个向量中的每个值都是一个样本的真实label与估计值的误差。

#再反向传播算出计算图中各节点的梯度,其中l.sum()/batch_size为标量

l.mean().backward()

sgd([w,b],lr)#使用当前这个小批量数据进行梯度下降来更新参数w,b 。同时在该函数中将计算图中的每个节点的梯度清0,防止梯度累计。

#每个epoch输出一下误差

with torch.no_grad():

#此时w,b已经经过一个epoch的更新,得到此时预测值与真实值得均方误差

error_now = loss(net(X,w,b),y)

print(f"epoch:{epoch} loss:{float(error_now.mean()):f}")#在width后面,直接加f,表示补足小数点后的位数至默认精度6

- 每次遍历一个epoch,每个epoch使用feature,label存储从data_iter中得到的batch_size个特征和标签。

- 对于每个epoch中的每一个批量,先使用均方误差函数计算误差,这个过程相当于正向传播,会得到各节点的计算图,同时得到的l是一个形状为(batch_size,1)的列向量,其中的每个值是该批量中一个样本的预测值和真实值间的误差。然后计算这个向量 l 的均值(可以用l.mean(),也可以用 l.sum()/batch_size)得到一个标量,接着就是反向传播得到计算图中各个节点的梯度了。然后使用sgd更新参数w,b。当跑完了一个epoch的所有的小批量数据后,此时的w,b已经经过了 总的样本数/batch_size 次更新,使用该参数计算一下平均loss并打印,就是当前这个epoch的均方误差。

一般来说,随着epoch增加,loss会不断下降。但epoch太高可能会过拟合,亦有可能很早的找到局部最优解但一直停不下,浪费资源。

这次的总结就到这了,如果有一起看沐神的小伙伴,欢迎一起讨论,一起进步~

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

https://www.bilibili.com/video/BV1PX4y1g7KC?p=3

https://www.bilibili.com/video/BV1PX4y1g7KC?p=3

所有评论(0)